Sylvain, vient d’accepter un poste de DSI (CTO ou CIO comme vous voulez) dans une PME à fort potentiel. Lors de son premier jour il arrive heureux et motivé dans sa nouvelle entreprise.

Le premier briefing de son patron est le suivant :

« Sylvain, nous avons pleins de projets informatique très importants mais là où je t’attends surtout c’est la B.I. «

« J’ai besoin d’avoir ça rapidement et j’ai même l’ambition de faire à terme de la BigData«

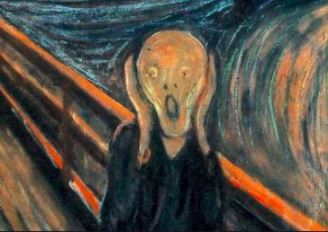

Et là bim! les mots sont lancés, tous les concepts de BI mélangés à la BigData se mélangent dans la tête de Sylvain(Les travaux de Bill Inmon sur l’entrepôt de données et ceux de Ralph Kimball sur la modélisation, les outils décisionnels du marché, la théorie des 4 V pour la big data…).

Emballé par ce projet Sylvain, décide de prendre rendez vous avec chaque responsable de service afin de jauger la maturité de l’entreprise sur ce sujet.

Et là c’est le drame !

Sylvain comprend rapidement que le projet a déjà été initié plusieurs fois mais n’a jamais abouti pour de très nombreuses raisons.

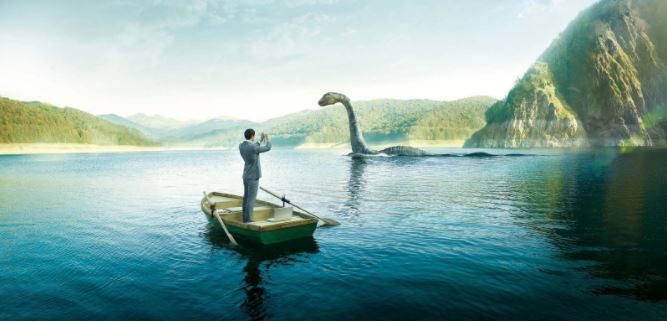

Bienvenue dans le serpent de mer de la Business intelligence Sylvain!

Selon le Gartner, 70% de projets de BI échoueraient. Mais il y a pire, 85% des statistiques seraient erronées !

D’après Capgemini, les initiatives Big Data ne sont que dans 27% des cas qualifiées de réussites. S’y ajoutent 8% qui n’hésitent pas à parler de franc succès. Pour les autres, les attentes n’ont donc pas été satisfaites.

Pour autant, des démarches se mettent en place en entreprise selon une étude de Capgemini. Parmi les répondants, seuls 13% font état de projets entrés en phase de production. Les réalisations partielles (35%) et les PoC (29%) sont la règle.

Alors, comment éviter les pièges de la BI ?

De mon point de vue (outre les difficultés techniques) il y a 2 gros pièges à la BI.

Piège numéro 1, La gouvernance des données

Considérons cette définition :

« La gouvernance de la donnée est un ensemble de processus qui assurent que ces données sont formellement gérées à travers l’entreprise. Elle garantit la fiabilité des informations utilisées pour les processus métier critiques, la prise de décision et la comptabilité. »

Les data scientistes passent 60% de leur temps à nettoyer / organiser de la donnée et seulement 19% à la collecter. Assurer une bonne gouvernance des données est primordial dans un tel projet sinon vous ne garantirez jamais des résultats justes.

Pour vous aider dans ce vaste chantier voici quelques outils :

- Le premier outil (et le plus important) sera l’organisation mais nous y reviendrons plus tard.

- Le Data Lineage, c’est une cartographie des données et de leurs cycles de vie.

- La matrice d’exigence, ceci vous permettra de hiérarchiser vos exigences afin de vous permettre de mieux détecter les incohérences.

Piège numéro 2, Ce n’est pas qu’un projet IT

Nous en avons un peu parlé dans le point précédent, attention l’objectif de la BI est avant tout de donner de la valeur à vos données.

Même si c’est super pour un tec de se plonger dans les méthodes de modélisations… le plus important est que le résultat doit servir la société et pour cela il n’y a qu’une solution, votre société doit transpirer la data.

Tout d’abord il vous faut une personne qui portera cette lourde responsabilité. Ce peut être un Chief Quality Officer qui fera respecter les processus de mise en qualité des données. Il devra être aidé par des Data Owners, dans une organisation agile ce peut être très intéressant d’intégrer la fonction de Data Owners dans les Squads. Ainsi vous garantirez que tous vos projets intègrent cette spécificité.

Enfin pour les geeks de la modélisation

Les travaux de Bill Inmon sur l’entrepôt de données et ceux de Ralph Kimball sur la modélisation sont les fondations du décisionnel.

Les principales avancées portent sur trois grands thèmes :

- Une architecture technique dédiée pour le décisionnel avec une base de données pour le stockage, un outil de type ETL (Extraction Transformation Loading) pour alimenter la base à partir des systèmes sources et de différents outils pour restituer les informations aux utilisateurs.

- Une architecture fonctionnelle à plusieurs étages avec un ODS (Operational Data Store), un entrepôt de données (datawarehouse), des magasins métiers (datamarts). Tout ceci permettant de transformer de la donnée brute en informations contextualisées et qualifiées pour des utilisateurs métiers.

- Une modélisation en étoile (star schema) offrant aux utilisateurs un accès simplifié aux données et d’excellents temps de réponse à leurs requêtes.

Cette approche a permis de répondre aux besoins de pilotage des entreprises. L’accroissement démesuré des volumes de données ont en effet mis en lumière une limitation technique de nos architectures classiques qui conduira à l’avènement du Big Data.

Allez courage sylvain un peu de pédagogie et d’organisation et le tour sera joué 😉

Ping : Mais arrêtez de penser PIM only 😤 - David LANGLADE